Die Verbreitung von auf künstlicher Intelligenz basierenden Tools in Büros hat eine neue Schwachstelle im Unternehmensnetzwerk geschaffen.

Gefährdet Ihr KI-gestützter Chatbot Ihr Büro? Die Einführung zahlreicher auf künstlicher Intelligenz basierender Tools in Unternehmen und Behörden hat neue Risiken für die Netzwerksicherheit geschaffen. Unternehmen wie Samsung verbieten den internen Einsatz von ChatGPT mittlerweile aus gutem Grund: Ingenieure in der Halbleitersparte hatten den Konversationsagenten genutzt, indem sie ihm vertraulichen Quellcode zur Verfügung stellten, den sie verbessern wollten. Wir können auch die Stadt Montpellier zitieren, die die gleichen Anweisungen und Blockaden auf die Positionen der städtischen Angestellten angewendet hat. Die Befürchtung wäre immer dieselbe: Mitarbeiter geben zu viele sensible Informationen an ChatGPT weiter.

Viele große Gruppen haben daher einen anderen Ansatz favorisiert: die Entwicklung ihrer eigenen internen künstlichen Intelligenz, basierend auf den „Geschäftsgrundlagen“ von ChatGPT oder Claude. Teilweise lokal gehostete Daten, Mitarbeiter, die das interne Tool optimieren, alles scheint theoretisch einwandfrei. Abgesehen davon, dass dieses Tool, wie andere auch, hackbar ist. Und der Gewinn kann umso interessanter sein, wenn der Cyberkriminelle den Zugang zu diesem allen Mitarbeitern angebotenen Programm gestohlen hat.

Was sind konkret die Risiken? „ Wenn ein Hacker Zugriff auf das professionelle Konto eines beliebten Chatbots hat, kann er darauf übertragene sensible Dokumente oder sogar den Chat-Verlauf finden », erklärt Adrien Merveille, Cybersicherheitsexperte bei Check Point. „ Auch ein intern entwickeltes Programm ist nicht immun. Der Cyberkriminelle kann Code-Poisoning versuchen, um die von einer KI erzeugten Ergebnisse zu verändern und dem Unternehmen Schaden zuzufügen » fügt der Spezialist hinzu. Ein Unternehmen, das Kamerabilder analysiert, könnte beispielsweise bei den Analysen seines Programms getäuscht werden.

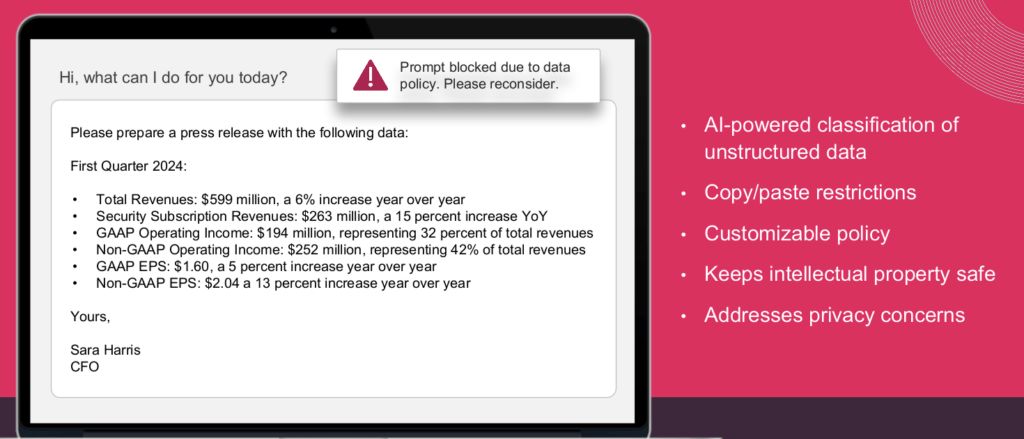

Module zum Blockieren von Anfragen an ChatGPT

Cyberangriffe: Wenn der Mensch das schwache Glied ist

Mit U-Cyber 360° ermöglicht Ihnen das französische Unternehmen Mailinblack, Ihr Unternehmen zu schützen und Ihre Mitarbeiter in Cybersicherheit zu schulen.

Vom Passwort-Manager über E-Mail-Sicherheit bis hin zu Weiterbildungen und Angriffssimulationen vereint diese Lösung alle Tools, um Cyber-Risiken vorzubeugen.

Es entstehen Lösungen zur Sicherung dieser neuen internen Tools. Das Unternehmen Check Point bietet jetzt Module für Suchmaschinen an, um die Anfragen eines Mitarbeiters auf ChatGPT zu blockieren, wenn er private Informationen preisgibt.

Wenn Sie eine Zusammenfassung auf der Grundlage der Ergebnisse der verschiedenen Unternehmenszweige anfordern, wird diese blockiert, da sie Informationen enthält, die als vertraulich gelten.

ANSSI, die für den digitalen Schutz der französischen Verwaltung zuständige Wache, hat sich ebenfalls mit dem Thema befasst und im vergangenen Frühjahr eine Online-Broschüre bereitgestellt, um den Einsatz von KI in der Wirtschaft zu sichern.

« Der grundlegendste Fehler besteht darin, zu glauben, dass künstliche Intelligenz ein eigenständiges Thema sei, und dabei zu vergessen, dass für deren Verwendung keine Sicherheitsregeln gelten » warnt Vincent Strubel, Generaldirektor von ANSSI. „ Wir bemerken einige Fehler in der Praxis, KI, die sich online aktualisiert, die nicht überwacht wird … Bevor wir das Programm eine Entscheidung treffen lassen, empfehlen wir, es gut zu beherrschen. » erklärt er uns.

Um voranzukommen, würde ANSSI in Betracht ziehen, dass Etiketten sichere Programme für künstliche Intelligenz verwenden. Für Cybersicherheitslösungen gibt es diese nationalen Zertifizierungen bereits, die Kriterien für eine sichere KI müssen jedoch noch gefunden werden.

In der Zwischenzeit können Sie ChatGPT jederzeit bitten, den Chat-Verlauf nicht aufzubewahren, um eine Fütterung seiner KI zu vermeiden.