« Wir werden die Faktenprüfer abschaffen “. Diese Aussage von Meta-Chef Mark Zuckerberg vom Dienstag, 7. Januar, sorgte bei Fachleuten im Kampf gegen Desinformation für große Besorgnis. Während einige die Faktenprüfung in den Netzwerken abschaffen wollen, versuchen andere im Gegenteil, den Zugang zu verifizierten Informationen zu erleichtern. Dies ist der Fall bei der NGO La Response Tech, die kürzlich Vera, einen Konversationsverifizierungsbot, auf den Markt gebracht hat.

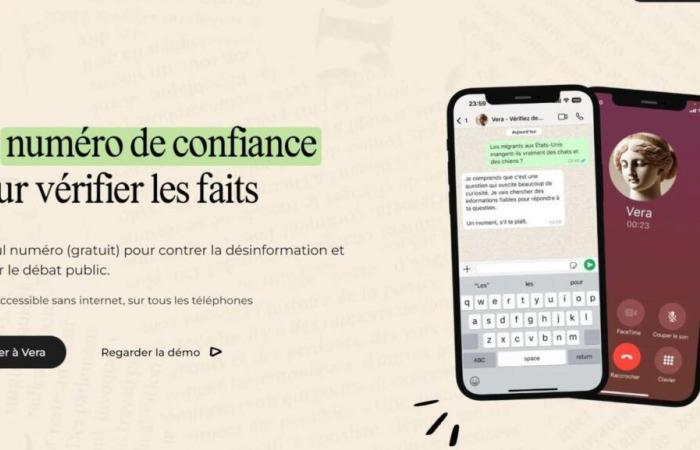

Mithilfe künstlicher Intelligenz kann jeder Informationen in Echtzeit überprüfen. Dies ist die Mission, die das Bürgerkollektiv La Response Tech mit der Entwicklung von Vera ins Leben gerufen hat. ein digitaler Gesprächsagenterreichbar 24 Stunden am Tag, 7 Tage die Woche. Konkret müssen Sie lediglich Veras Telefonnummer 09 47 99 12 95 anrufen oder ihr eine Nachricht auf WhatsApp senden und fragen, ob diese Informationen wahr oder falsch sind.

Für dieses Beispiel haben wir freiwillig eine Frage zu einer gefälschten Nachricht gestellt, die von bestätigt wurde die Zelle RFI-Verifizierungsinformationen. Diese künstliche Intelligenz basiert jedoch auf der Arbeit mehrerer hundert zuverlässiger Quellen, die von einem Expertengremium ausgewählt wurden und frei einsehbar.

« Basierend auf der vom Benutzer gestellten Frage prüft Vera zunächst, ob es in einem Leitartikel zur Faktenprüfung dieses Thema gibt. Ist dies nicht der Fall, wird die Antwort von 300 als zuverlässig anerkannten Medienseiten eingeholt, bevor eine Synthese erstellt und in Echtzeit angeboten wird », erklärt Gründer Florian Gauthier. Technisch gesehen basiert Vera auf dem GPT-4-Sprachmodell, das von der amerikanischen Firma Open AI entwickelt wurde.

Florian Gauthier – Wie Vera funktioniert

Heute wird Vera jede Woche von rund 700 einzelnen Benutzern genutzt.

Eine KI modelliert, um Fehler zu vermeiden

Wie jedes KI-basierte Tool ist Vera nicht unfehlbar. Es besteht die Gefahr eines Fehlers oder einer unvollständigen Antwort. Aber im Gegensatz zu Chatbots wie ChatGPT, Perplexity oder Claude ist Vera nicht darauf ausgelegt, die gestellte Frage um jeden Preis zu beantworten. „ Vera ist es völlig verboten, sich etwas vorzustellen. Sobald sie eine Antwort formuliert, stammt diese Antwort aus einer zuverlässigen Quelle, die immer zitiert wird. Wenn Vera die Antwort nicht in ihrer Datenbank findet, was von Zeit zu Zeit vorkommt, wird sie nicht versuchen, sie zu erfinden. Sie wird dann lediglich angeben, dass sie die Antwort auf diese Frage nicht gefunden hat. », erklärt Florian Gauthier.

Florian Gauthier – Halluzinationen vermeiden

Eine weitere Einschränkung besteht darin, dass die Datenbank nicht vollständig sein kann. Daher ist es möglich, dass Vera Ihnen sagt, dass sie es nicht weiß, auch wenn das Thema bereits verifiziert wurde. Aber unseren Tests zufolge ist Vera heute der effektivste Konversationsbot zur Überprüfung von Informationen in Echtzeit. In Zukunft planen die Macher, Vera mehrsprachig zu machen und den Dienst kostenlos auf anderen Plattformen und sozialen Netzwerken anzubieten.

Kampf gegen verschwörerische Reden

Abgesehen davon, dass dieser Überprüfungsprozess in Echtzeit möglich ist, könnte diese Art von Konversationsagenten bei bestimmten Benutzern auch das Festhalten an Verschwörungstheorien einschränken. Das zeigt eine aktuelle Studie veröffentlicht in der wissenschaftlichen Zeitschrift Natur. « Viele Menschen, die fest an scheinbar unbegründete Verschwörungstheorien glauben, ändern möglicherweise ihre Meinung, wenn überzeugende Beweise vorgelegt werden. (…) Dialoge mit KI reduzieren Verschwörungsglauben dauerhaft, selbst bei den glühendsten Gläubigen », schließen die Forscher.

Um diesen X-Inhalt (Twitter) anzuzeigen, ist es notwendig, Cookies zur Zielgruppenmessung und Werbung zuzulassen.

Akzeptieren

Verwalten Sie meine Entscheidungen

Für Florian Gauthier: „ Künstliche Intelligenz ist ein großartiges Werkzeug zur Verbreitung falscher Informationen. Aber im Gegenteil kann KI auch eine echte Antwortmöglichkeit im Kampf gegen Desinformation sein ».