Apple hat noch nicht reagiert

Was ist gerade passiert? Nur wenige Tage nachdem Apples KI-gestütztes Benachrichtigungszusammenfassungstool eine gefälschte BBC-Schlagzeile über Luigi Mangione veröffentlichte, fordert eine große Handelsorganisation das Unternehmen auf, die Funktion vollständig zu entfernen. Es ist der jüngste Rückschlag bei Apples Versuchen, Kunden davon zu überzeugen, dass sich der Einsatz seiner KI lohnt.

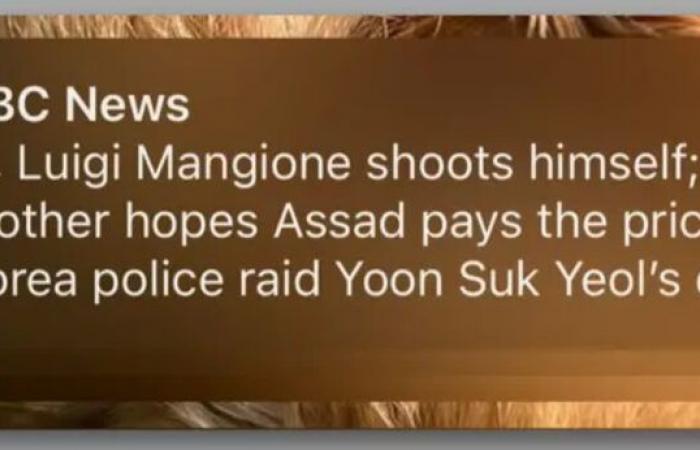

Am 13. Dezember veröffentlichte Apple Intelligence, das in der Vergangenheit erhebliche Fehler bei der Zusammenfassung von Benachrichtigungen gemacht hat, eine Zusammenfassung mehrerer Schlagzeilen der BBC, darunter die Behauptung, Mangione habe Selbstmord begangen. Der Vorfall ereignete sich nur 48 Stunden nach der Einführung von Apple Intelligence in Großbritannien.

Mit freundlicher Genehmigung von BBC News

Mangione, der in New York verhaftet und wegen Mordes ersten Grades an Brian Thompson, CEO von UnitedHealthcare, angeklagt wurde, beging keinen Selbstmord. Er bleibt in der Huntingdon State Correctional Institution im Huntingdon County, Pennsylvania, in Haft.

Dies ist sicherlich nicht das erste Mal, dass Apple Intelligence in einer zusammenfassenden Benachrichtigung einen Fehler gemacht hat. Zuvor behauptete er, der israelische Ministerpräsident Benjamin Netanjahu sei verhaftet worden, nachdem der Internationale Strafgerichtshof einen Haftbefehl erlassen habe.

Reporter ohne Grenzen (RSF), eine internationale gemeinnützige NGO, die sich dem Schutz des Rechts auf Informationsfreiheit widmet, fordert Apple auf, die Funktion zur Benachrichtigungszusammenfassung zu deaktivieren.

RSF schreibt, dass dieser Vorfall verdeutlicht, dass generative KI-Dienste noch zu unausgereift sind, um verlässliche Informationen für die Öffentlichkeit zu produzieren, und dass sie für solche Zwecke nicht auf den Markt gebracht werden sollten.

Die Gruppe fügte hinzu, dass die probabilistische Funktionsweise von KI-Systemen sie automatisch als zuverlässige Technologie für Nachrichtenmedien disqualifiziere.

„KIs sind Wahrscheinlichkeitsmaschinen und Fakten können nicht durch einen Würfelwurf entschieden werden. RSF fordert Apple auf, verantwortungsvoll zu handeln und diese Funktionalität zu entfernen. Die automatisierte Produktion falscher Informationen, die einem Medienunternehmen zugeschrieben werden, ist ein Schlag für seine Glaubwürdigkeit. und eine Gefahr für das Recht der Öffentlichkeit auf verlässliche Informationen über aktuelle Ereignisse, erklärt Vincent Berthier, Leiter der RSF-Abteilung für Technologie und Journalismus.

„Die EU-KI-Gesetzgebung – obwohl sie in diesem Bereich die fortschrittlichste Gesetzgebung der Welt ist – hat informationsgenerierende KIs nicht als Hochrisikosysteme eingestuft, was eine kritische Rechtslücke hinterlässt. Diese Lücke muss umgehend geschlossen werden. »

Als die BBC auf die gefälschte Schlagzeile aufmerksam wurde, kontaktierte sie Apple, um Bedenken zu äußern und das Unternehmen aufzufordern, das Problem zu lösen.

Die fragliche Kurzmitteilung enthielt drei Schlagzeilen: die falsche über Mangione und zwei korrekte Schlagzeilen über den Sturz des Regimes von Baschar al-Assad in Syrien und ein Update über den südkoreanischen Präsidenten Yoon Suk Yeol.

Laut Apple ermöglicht die Zusammenfassungsfunktion seiner KI Benutzern, lange oder gestapelte Benachrichtigungen mit wichtigen Details direkt auf dem Sperrbildschirm zu analysieren, beispielsweise wenn ein Gruppenchat besonders aktiv ist. Er versteht Zusammenfassungen oft falsch oder versteht ihren Kontext nicht, manchmal auf urkomische Weise.

Die Verbreitung gefälschter Nachrichten wird Apple immer in Schwierigkeiten bringen, insbesondere in einer Zeit, in der Unternehmen versuchen, die Menschen davon zu überzeugen, dass KI die Zukunft von fast allem ist. Apple hat noch nicht auf den Vorfall reagiert, erwartet jedoch nicht, dass die Funktion dauerhaft entfernt wird. Cupertino könnte es allenfalls für eine Weile deaktivieren.