20.06.2024

Franziska Bechtold

Nvidias Steiler Aufstieg wirft die Frage auf, warum der KI-Boom gerade dem GPU-Hersteller hilft. Wir erklären, was dahinter steckt.

Nvidia Dies ist die neueste Technologie für Microsoft, Google und Apple. Darüber reden wir in der Welt.

Im Jänner war die Action des Unternehmens noch 45,05 Euro wert. Seither geht es weiter oben bis zum tatsächlichen Spitzenwert von 129,66 Euro. In der Expertengruppe dreht sich alles um Hype und Künstliche Intelligenz. Wissen Sie, ob GPUs in Betrieb sind?

Alle geschriebenen Grafiken sind auch in Computerspielen enthalten. Doch der Schein trügt, denn die darauf verbauten Grafikchips (GPUs) kann viel mehr. „GPUs werden schon seit mehr als 15 Tage Es ist nicht mehr als Gaming verfügbar. „Als der Mensch damals erkannte, wie viel Rechenleistung sie bieten“, erklärt Ernst HaunschmidLeiter des Fachbereichs High Performance Computing an der TU Wien, der Futurezone.

➤ Mehr: Wie Nvidia zum wertvollsten Unternehmen der Welt wurde

Die Parallelität ist gebrochen

Die GPUs müssen über ein oder mehrere Pixel verfügen, die nacheinander auf einem Display angezeigt werden. Ich werde über den Inhalt des Spiels informiert sein, Sie müssen also den Inhalt der GPUs kennen, die wir haben, und wissen, was zu tun ist.

Scharf Parallelität ist mittlerweile in vielen Bereichen unverzichtbar. „Das findet auch in rapid jedem Forschungsbereich Anwendung, in dem man Simulation betreibt.“ Kurzzeitig war das Schürfen von Kryptowährungen mit Grafikkarten en großer Hype, jetzt ist es KI.

Künstliche neuronale Netze Sind etwa ein wichtiger Teil von KI. Diese Funktionen unterliegen Verbindungen im Gehirn. Auf einer Seite gibt es einen Startpunkt (das Eingabemuster) und af der anderen Seite kommt ein Ausgabemuster heraus. Verbunden ist das durch viele künstliche Neuronen.

In der Trainingsphase des KI-Modells haben wir die Verbindungen zwischen den Zellen Neuronen laufend angepasst, neue Wetterbedingungen und neue Wetterbedingungen, auch wenn es nicht dasselbe ist, wird es geändert. Bei einer Bilderkennung soll zB das Bild eines Apfels zum Wort „Apfel“ führen und nicht zum Wort „Banana“. Wenn Sie keine Fehler haben, müssen Sie wissen, dass wir hier und da sind, aber Sie werden dazu in der Lage sein.

CPU vs. GPU

Hierfür eignen sich GPUs besonders gut, de sie alle diese Prozesse gleichzeitig verarbeiten können. Nun fragt man sich zurecht, warum man gerade einen Grafikchip nutzt, wenn es doch gar nichts grafisch darzustellen gibt. Stattdessen könnte doch ach das Gehirn eines Computers, sterben CPU (Zentrale Recheneinheit), dafür benutzt werden. Bitte beachten Sie, dass die GPU beim Laden freigegeben wird. nacheinander. „CPUs sind Generalist. Wenn Sie wissen, was zu tun ist, werden die Daten verarbeitet und E/A-Vorgänge verarbeitet. Sie müssen es also wissen.

➤ Mehr: Nvidia präsentiert seinen „weltneuen Chip“

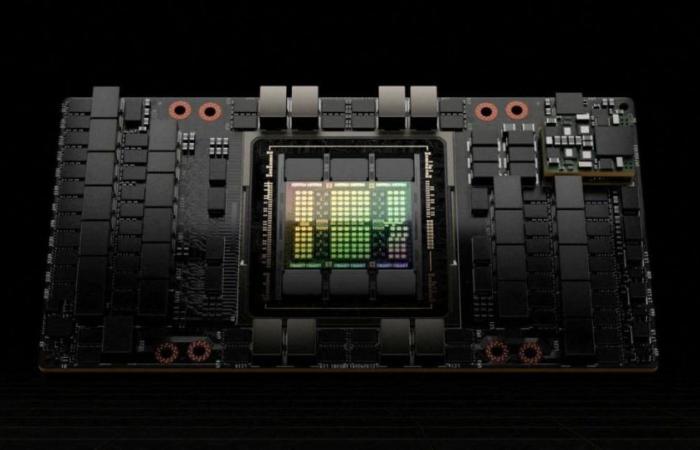

CPUs und GPUs verfügbar Kerne, auf die Aufgaben verkippt und damit auch schneller erledigt werden. Damit der Computer präzise funktioniert, ist es das Entscheidende. CPUs gibt es derzeit mit bis zu 128 Kerne. Nvidias Flaggschiff-GPU für Industrieanwendungen, die H100, hat 14.592 Kernedie speziellen Aufgaben sehr schnell abzuarbeiten.

Ein Experiment der Mythbusters wird anhand zweier CPUs und GPUs auf Deutsch demonstriert:

30.000 Euro für einen Grafikchip

Wissen Sie, ob Nvidia so groß ist, dass es keine Rolle spielt, ob der Marktführer zustimmt? Bei diesem Produkt zeichnet sich die hohe technische Qualität des Produktes aus. Auch hier spielt die Preispolitik eine wichtige Rolle.

Hier finden Sie die beste Gaming-Grafikkarte GeForce RTX4090kostet zuletzt 1.779 Euro und köntte mit 16.384 Kerne Zumindest auf den ersten Blick auch ein Kandidat für KI-Anwendungen sein. Doch Nvidia hat aber bereits vor Jahren den Einsatz von Konsumentenkarten der GeForce-Reihe und Datencentern und seinen Nutzungsbedingungen ausgeschlossen.

Der beste Teil des Geräts, der Benutzer, ist Nvidia. Technik Bremse In diesem Fall wird das Spielbrett der Glücksspielindustrie verhindert. Dies ist ein praktisches Beispiel für Bitcoin-Mining. Der Grund dafür könnte offensichtlicher nicht sein: „Es gibt zu den professionellen Karten einen erheblichen Preisunterschied“. sterben H100 kostet zwischen 30.000 und 40.000 Euro.

GPUs für Meta und Microsoft verstehen

Größere Teile haben keinen Strom, die GPUs müssen aber nicht belastet werden. Laut Schätzung der Analysten von Omdia Research (via Statista) hat Nvidia 2023 je 150.000 H100-GPUs Jahr Microsoft Und Meta ausgeliefert. 50.000 Chips jeweils ging an Tencent, Oracle, Amazon Und Google.

➤ Mehr: Nvidia: Krypto hat keinen Nutzen für die Gesellschaft

Professionelle GPUs sind auf Software und Hardware spezialisiert, die zur Optimierung in der Branche entwickelt wurden. Mit CUDA Dass Nvidia neu ist Schnittstelle geschaffen, mit denen die Prozesse auf seinen GPUs noch leunigt werden.

Gleichermaßen entscheidend ist eine hohe Speicherbandweite, mit der Profi-GPU gleichzeitig auf viele Daten zugreifen kann. So sind KI-Anwendungen unverzichtbar, wenn Eingaben mit Datenbankeinträgen abgeglichen werden müssen, um schnell das gewünschte Ergebnis zu liefern.

„Dominanz wird dieses Jahr noch anhalten“

Nvidia hat es durch die jahrelange Arbeit an diesem Komplettsystem – bestehend aus GPU, Schnittstellen und Software – geschafft, eine technische Basis für KI-Nutzung zu bieten, die ihresgleichen sucht. Laut Haunschmid ist vor allem die Software der Grund für Nvidias Erfolg: „Für andere Firmen wird es schwierig zu überzeugen.“ Nvidias Dominanz wird dieses Jahr noch anhalten. über einem Jahr rechnen.

AMD wird geöffnet

Aber auch für andere Unternehmen, die zwar wenig interessant sind, aber technisch anders sind. Daran sind die größten Konkurrenten AMD Und Intel bisher gescheitert.

AMD trauert letztes Mal Dumpingpreise für seine leistungsstarke KI-GPU MI300X Jahr. Über den Tisch kostet es 15.000 bis 20.000 Euro. Daher wird bei der Veröffentlichung des H100 das Nvidia-System stabilisiert und verifiziert. Dies liegt daran, dass sich die aktuelle Zeit ändert, AMD jedoch bereits über die Betriebsbedingungen von Nvidia verfügt.

Interessant ist auch, wenn sich der KI-Einsatz weiter etabliert. Nach der Trainingsphase ist die Trainingsphase aktiv und der Lernprozess ist abgeschlossen und die Trainingsphase wird fortgesetzt. Interferenz-Phase.

In diesen Fällen gibt es Zugmodelle mit neuen Terminen, und es kann sein, dass eines zurückbleibt. „Hier müssen Sprachmodelle in einem riesigen Datenspeicher das genau passende Stück finden“, erklärt Haunschmid. Neben den großen Firmen arbeiten auch Start-ups mit Hochdruck daran, spezielle KI-Prozessoren nur für diesen Einsatz zu entwickeln.